AI-agenter går snabbt från imponerande demo till verktyg som faktiskt kan agera åt dig, och OpenClaw är ett av namnen som drivit den senaste uppmärksamheten. Du kanske hört samma mjukvara kallad Clawdbot eller Moltbot — namn som användes i olika utvecklingsfaser av dess skapare, österrikaren Peter Steinberger.

Marknadsförd som en helt självgående personlig assistent som kan hantera program åt dig, väcker den samtidigt viktiga frågor om åtkomst och säkerhet.

- AI-agenter är handlingseffektiva AI-system, inte bara konversationsverktyg.

- Verktyg som OpenClaw visar hur kraftfulla självhostade AI-agenter kan bli.

- Denna kraft medför nya säkerhetsrisker när agenter bearbetar opålitlig information.

- Promptinjektion är ett centralt hot för AI-agenter, ännu mer än för vanliga chattbotar.

- Persistenta minnen kan förstärka misstag och förlänga attacker.

- AI-agenter är kraftfulla, men inte en säker standardlösning för de flesta konsumenter.

Vad är hypen kring OpenClaw?

OpenClaw får uppmärksamhet eftersom det visar en förskjutning från AI som svarar på frågor till AI som faktiskt utför uppgifter i ett riktigt system och till och med kan använda annan mjukvara. De potentiella säkerhetsproblemen har också lett till att fler i säkerhetskretsar diskuterar OpenClaw. Vad gör OpenClaw attraktivt för utvecklare och avancerade användare?

OpenClaw sticker ut eftersom det kan vidta verkliga åtgärder, inte bara generera text eller förslag. Istället för att säga åt dig vad du ska göra kan det göra saker själv. Tekniken kan öppna appar, skicka meddelanden, flytta filer, köra kommandon och interagera direkt med system åt dig.

Denna nivå av automatisering är vad som väcker intresse. Utvecklare och drivna användare ser systemkontroll som ett sätt att minska repetitivt arbete eller automatisera arbetsflöden. Idén om en AI-agent som kan utföra jobbet snarare än bara assistera från sidan är stark.

Det löfte om praktisk kapacitet är anledningen till att OpenClaw snabbt gått från ett nischprojekt till bredare diskussion.

Varför detta spelar roll bortom OpenClaw

OpenClaw ger ett synligt exempel på en bredare förskjutning mot AI-agenter som verkligen agerar, inte bara svarar och ger råd.

Frågor om möjlig missbruk blir oundvikliga när den här typen av teknik växer. Det OpenClaw visar är åt vilket håll AI är på väg. Det gör det relevant långt utanför ett enskilt projekt och lägger grunden för fortsatta diskussioner om hur dessa agenter bör kontrolleras. Kan man lita på dem?

Vad är AI-agenter, och vad skiljer dem från andra AI-verktyg?

AI-agenter är system som inte bara ger text- eller ljudsvar på dina frågor. De kan aktivt planera steg och utföra åtgärder för att nå ett mål. Istället för att stanna vid råd bestämmer de vad som ska göras härnäst och utför det.

En AI-agent kan observera en situation och vidta åtgärder. Det skiljer sig från de flesta AI-verktyg, som svarar på prompts men väntar på nästa instruktion. Tidiga exempel inkluderar uppgiftsutförandeagenter som Manus (nu ägt av Meta). Manus visar hur agenter kan gå från chatt till handling. Den kan leverera dataanalys eller till och med skriva kod aktivt för att lösa problem utan att bli instruerad i detalj. Den mänskliga inblandningen minskar.

OpenClaw bygger vidare på samma idé om handlingseffektiva AI, men tillämpar den på ett mer direkt och kraftfullt sätt.

Är OpenClaw en typisk AI-agent eller något mer avancerat?

OpenClaw faller inom kategorin AI-agenter. Det erbjuder en mer kraftfull implementation än många av de verktyg de flesta användare idag är bekanta med.

Detta AI-verktyg kan planera uppgifter och agera utan ständig inmatning. OpenClaw kan interagera direkt med mjukvara och operativsystem, inte bara med API:er eller begränsade verktyg. Denna bredare åtkomst ökar användbarheten och särskiljer det. Samtidigt höjs insatserna och vikten av säkerhet.

Varför lokalt körda AI‑agenter skiljer sig åt

Lokalt körda AI‑agenter körs på din egen dator i stället för på en fjärrtjänst. Det ger användaren mer kontroll över konfiguration och beteende. Det flyttar också ansvaret.

När en agent har lokal åtkomst beror säkerheten på hur den är uppsatt, vilka behörigheter den har och hur den övervakas. Mer kontroll innebär större ansvar och ofta högre risk.

Nyare projekt visar hur begreppet 'lokalt körd' börjar förändras. Till exempel kan Moltbot (tidigare Clawdbot) nu köras med Cloudflares öppna källkodsprojekt Moltworker. Det tar bort behovet av separat lokal hårdvara genom att köra agenten på en hanterad plattform istället.

Det sänker tröskeln för att komma igång och förenklar installationen, men det flyttar också var kontrollen ligger. När en agent körs i molnet beror säkerheten inte bara på agenten själv, utan på åtkomstkontroller och hur data och behörigheter hanteras över plattformen.

Till exempel kan en användare koppla en AI-agent till sin e-post i förvissning om att den bara ska läsa meddelanden, medan molnuppläggningen även tillåter att den skickar e-post om inte den behörigheten uttryckligen är avstängd.

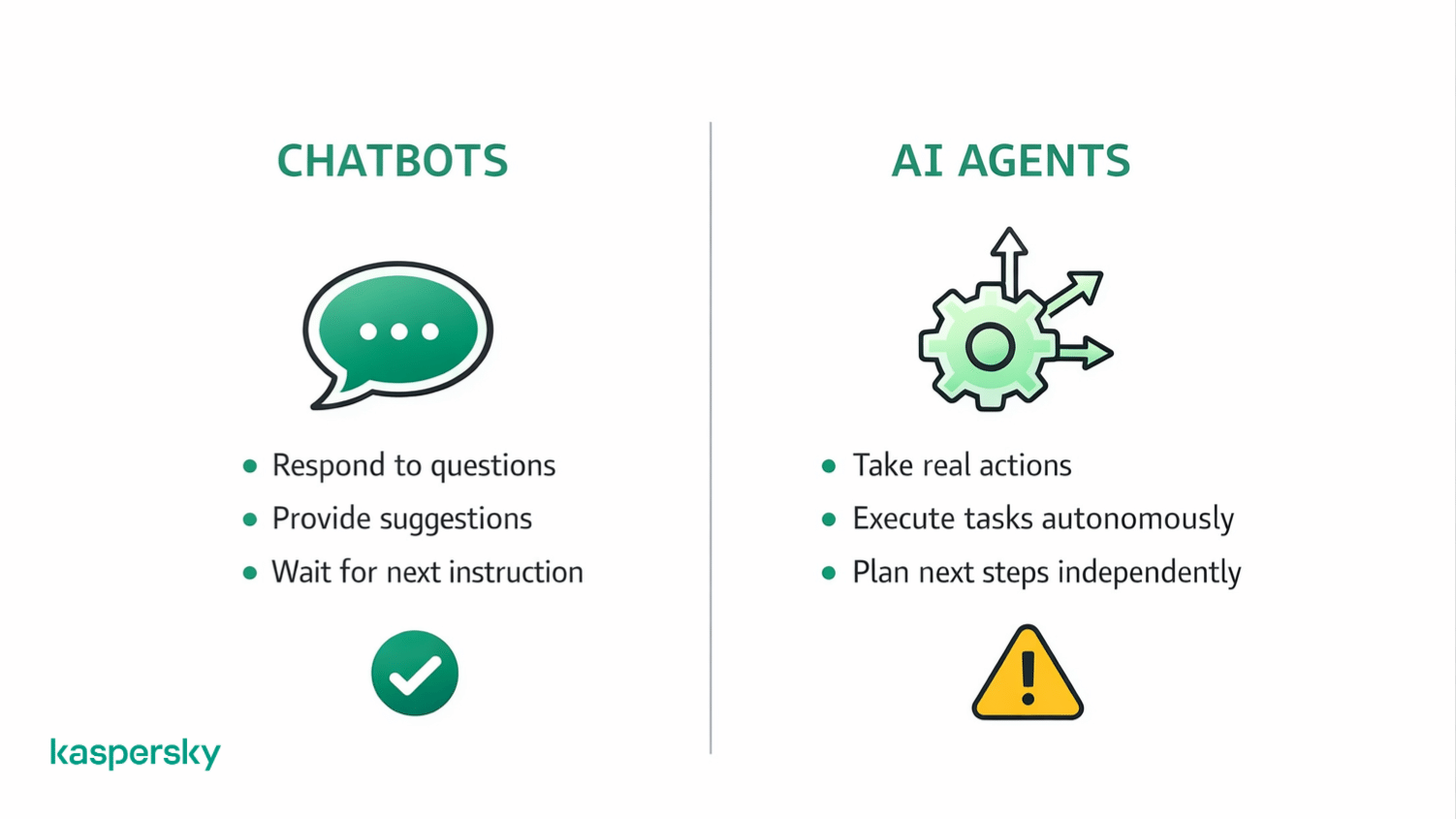

Hur skiljer sig AI-agenter från chattbotar som ChatGPT?

Chattbotar som ChatGPT svarar, medan AI-agenter agerar.

En chattbot kan ge förslag eller förklaringar. En AI-agent kan aktivt öppna program eller genomföra arbetsflöden.

Som exempel har vissa personer använt OpenClaw för att automatisera handel. De har tagit fram regler och bett AI inte bara ge råd (vilket ChatGPT också kan göra) utan faktiskt utföra affärstransaktioner.

Varför introducerar AI-agenter nya säkerhetsrisker?

Som tidigare nämnts tar AI-agenter åtgärder i stället för att bara ge råd. Det medför ofta åtkomst till filer, program eller systemfunktioner.

Systemåtkomst och autonomi som OpenClaw ges förändrar både konsekvenser och risk. OpenClaw kommer att begära tillåtelse att interagera med program eller utföra åtgärder som att skicka e‑post eller fylla i formulär utan ständig mänsklig övervakning. Det gör den till en joker.

Misstag eller manipulation kan få verkliga följder. Risken är inte bara vad agenten instrueras att göra, utan vad den tolkar som instruktioner medan den utför en uppgift.

Varför opålitlig indata är ett grundproblem

AI-agenter konsumerar stora mängder extern information (som webbsidor och dokument) för att avgöra vad de ska göra härnäst. Den informationen är inte alltid tillförlitlig.

Instruktioner behöver inte vara direkta. De kan döljas i text eller data som agenten läser medan den utför en uppgift. Det gör det möjligt för angripare att påverka en agents beteende utan att någonsin interagera med den direkt.

Detta skapar en tydlig väg till promptinjektion — där opålitlig indata används för att styra en agent att utföra åtgärder den aldrig var avsedd att göra.

Kraftfulla AI-verktyg kräver starkare skydd

AI-agenter kan få åtkomst till filer, e‑post och systemfunktioner. Kaspersky Premium hjälper till att upptäcka misstänkt aktivitet, blockera skadliga skript och skydda dina enheter mot verkliga cyberhot.

Testa Kaspersky Premium gratisVad är promptinjektion i AI-agenter?

Promptinjektion är ett sätt att manipulera en AI-agent genom att mata in opålitligt innehåll som förändrar hur den uppför sig.

Risken är inte en teknisk bugg i koden. Risken är att agenten kan behandla extern information — som meddelanden eller kommentarer — som instruktioner. När det händer kan agenten ledas till att utföra åtgärder den aldrig skulle ha fått i uppdrag att göra.

Hur promptinjektion fungerar i verkliga scenarier

Promptinjektion kan vara direkt eller indirekt.

- Direkt – en angripare inkluderar avsiktligt instruktioner i innehåll som agenten läser.

- Indirekt – agenten plockar upp dolda eller oväntade instruktioner från en webbplats eller ett meddelande den behandlar under normala uppgifter.

Nyckelproblemet är beteende. Agenten kan följa det den tolkar som vägledning, även om den vägledningen kommer från opålitliga källor. Ingen traditionell mjukvarubugg krävs för att detta ska inträffa.

Varför promptinjektion är farligare för AI-agenter än för chattbotar

Insprängda instruktioner påverkar vanligtvis svar och råd som chattbotar ger. Med AI-agenter kan de påverka faktiska handlingar.

Om en agent har åtkomst till filer eller systemkontroller kan manipulerade instruktioner leda till verkliga förändringar. Det är därför promptinjektion innebär en större risk för agenter. Samma teknik som ändrar textutgång i en chattbot kan utlösa oönskade åtgärder när en agent är involverad.

Vad är persistent minne i AI-agenter?

Persistenta minnen gör att en AI-agent kan behålla information över tid. Det betyder att den kan använda tidigare indata för att vägleda framtida beslut i stället för att börja om från början varje gång.

Vad persistenta minnen innebär för AI-agenter

En AI-agent kan lagra kontext och instruktioner över sessioner och utveckla föredragna ”beteenden”. Det hjälper agenten att arbeta effektivare genom att komma ihåg vad den lärt sig eller gjort tidigare.

Det innebär också att tidigare indata kan påverka senare beteende. Instruktioner eller antaganden som fångats upp i en tidigare uppgift kan fortfarande forma hur agenten agerar i en annan situation, även om användaren inte längre är medveten om dem.

Varför persistenta minnen ökar säkerhetsriskerna

Persistenta minnen kan ge upphov till fördröjda effekter. En skadlig instruktion kanske inte orsakar problem omedelbart men kan återuppstå senare när förhållandena stämmer.

Det gör sanering svårare. Det lagrade beteendet kan upprepas över flera uppgifter. För att återställa en agent helt krävs ofta att minnet rensas eller konfigurationerna byggs upp på nytt för att säkerställa att oönskad påverkan tas bort.

Vad händer när en AI-agent är felkonfigurerad eller exponerad?

En AI-agent kan nås eller påverkas på sätt som ägaren aldrig avsett, och förvandla ett hjälpsamt verktyg till en säkerhetsrisk.

Det kan ske av misstag eller missförstånd. Det kan också ske om tredje part försöker manipulera agenten.

Hur AI-agenter kan exponeras av misstag

Exponering sker ofta genom enkla misstag. Något så enkelt som svag autentisering eller alltför vida behörigheter kan göra en agent nåbar utanför dess avsedda miljö.

Att köra en agent lokalt gör den inte automatiskt säker. Om den ansluter till internet eller interagerar med andra system kan den påverkas. Lokal kontroll minskar vissa risker, men eliminerar dem inte.

Varför exponerade AI-agenter blir angreppsyta

När en agent är exponerad blir den något angripare kan undersöka, testa och manipulera. De kan försöka mata in specialkonstruerat innehåll, trigga åtgärder eller lära sig hur den beter sig över tid.

Eftersom agenter kan vidta verkliga åtgärder behöver missbruk inte likna ett traditionellt intrång. Missbruk kan innebära att styra beteende, extrahera data eller orsaka oönskade systemförändringar — allt utan att utnyttja en klassisk programvarusårbarhet.

Vad är den "dödande trefaldigheten" i AI-agentsäkerhet?

Den ”dödande trefaldigheten” beskriver tre förhållanden som tillsammans skapar allvarlig säkerhetsrisk för AI-agenter.

De tre förutsättningarna som möjliggör allvarliga attacker

- Den första förutsättningen är åtkomst till känslig data, såsom filer, inloggningsuppgifter eller intern information.

- Den andra är opålitlig indata, det vill säga att agenten konsumerar innehåll den inte fullt ut kan verifiera.

- Den tredje är förmågan att vidta externa åtgärder, som att skicka förfrågningar, modifiera system eller köra kommandon.

Var för sig kan dessa faktorer hanteras. De blir farliga när de bildar denna trefaldighet. En agent som läser opålitlig indata och kan agera på den skapar en tydlig väg för manipulation. Att begränsa vilka åtgärder en agent får utföra är avgörande.

Bör vanliga användare köra AI-agenter idag?

För de flesta är AI-agenter fortfarande experimentella verktyg. De kan vara användbara i rätt miljö. Nackdelen? De medför också nya risker som inte alltid är uppenbara.

När det kan vara rimligt att använda en AI-agent

En AI-agent kan vara vettig i kontrollerade och lågriskmiljöer. Det inkluderar att experimentera på en separat enhet. Vissa kör agenter som bara hanterar icke-känsliga uppgifter som att organisera filer eller testa arbetsflöden.

Tänk att du vill använda agenten för att skapa ett reseprogram inför en resa. Den kan få åtkomst till nödvändig information för detta och samtidigt förhindras från att kontakta personer direkt eller göra något allvarligt skadligt.

Om du är bekväm med att hantera inställningar och misstagen inte är högrisk kan en agent vara ett lärverktyg. Nyckeln är att hålla omfattningen liten och åtkomsten strikt begränsad.

När AI-agenter är en dålig idé

AI-agenter är olämpliga när de har åtkomst till känslig data eller viktiga konton. Att köra agenter utan förståelse för behörigheter eller faran med extern indata ökar risken snabbt.

Det är också fullt rimligt att avstå. Att välja att inte köra en AI-agent idag är ett förnuftigt beslut om bekvämlighet kommer på bekostnad av säkerhet eller sinnesro.

Vilka grundläggande skyddsåtgärder är nödvändiga när du använder AI-agenter?

Grundläggande skydd minskar risken och förhindrar att misstag blir allvarliga problem.

Kasperskys programvara kan ge ett extra skyddsskikt genom att flagga misstänkt beteende och hjälpa till att skydda konton från intrång. Våra paket blockerar allt från skadlig kod och virus till utpressningsprogram och spionappar.

Vilka säkerhetsåtgärder är mest väsentliga

Isolering är centralt. Kör agenter på separata enheter och konton när det är möjligt så att de inte påverkar viktig data eller system. Begränsa behörigheter till endast vad agenten verkligen behöver. Vi rekommenderar att du undviker att ge full system- eller kontotillgång som standard.

Godkännandesteg är också viktiga. Att kräva bekräftelse innan känsliga åtgärder genomförs skapar en paus som kan förhindra oavsiktligt beteende, till exempel att agenten spenderar pengar i ditt namn. Dessa enkla kontroller har stor effekt utan att lägga till mycket komplexitet.

Vad betyder AI-agenter för framtiden för konsumentinriktad AI?

AI-agenter pekar mot en framtid där AI-verktyg gör mer än att assistera. De agerar. Men den förändringen innebär avvägningar som konsumenter bara börjar lära sig hantera.

Vad detta skede säger om mognaden hos AI-agenter

AI-agenter är kraftfulla men omogna. De kan automatisera uppgifter, men har fortfarande svårigheter med aspekter av omdöme och säkerhet. Det betyder inte att agenter inte kan bli säkrare eller mer tillförlitliga. Det betyder att förväntningarna bör vara realistiska.

AI-agenter visar åt vilket håll utvecklingen går, men utbredd, vardaglig användning kräver bättre skydd och verktyg som är byggda med säkerhet i fokus från början.

Relaterade artiklar:

- Hur tar ChatGPT itu med cybersäkerhetsfrågor och potentiella risker?

- Vilka är riskerna med AI-cyberbrottslighet i dagens digitala landskap?

- Hur förbättrar AI och maskininlärning cybersäkerheten?

- Vilka är farorna med deepfake‑teknik i dag?

Rekommenderade produkter:

FAQs

Är OpenClaw gratis att ladda ner?

OpenClaw går att ladda ner gratis från GitHub. Det är öppen källkod, vilket innebär att fler personer kan modifiera och distribuera programvaran.

Är OpenClaw enkelt att sätta upp?

Det finns handledningar som snabbt får igång bots, men en mer avancerad installation kräver tid och specialistkunskap. Det är ytterligare en anledning till att det kan vara riskabelt att köra programvara som kanske inte är korrekt konfigurerad.